Giới Thiệu Thế Hệ AI Biết "Suy Nghĩ"

Là chuyên gia AI với 5 năm kinh nghiệm triển khai các hệ thống ngôn ngữ lớn, tôi nhận thấy một bước ngoặt quan trọng: Thế hệ LLM (Large Language Models) mới không chỉ tạo văn bản mà thực sự biết tư duy. Bài viết này sẽ giải mã cách các mô hình như ChatGPT (đặc biệt là phiên bản reasoning-focused) xử lý thông tin khác biệt hoàn toàn so với LLM truyền thống.

Phần 1: Bản Chất Của Mô hình ngôn ngữ lớn lập luận(Reasoning LLM)

1. Sự Khác Biệt Cốt Lõi

-

LLM truyền thống: Phản hồi nhanh bằng cách dự đoán token tiếp theo dựa trên mẫu có sẵn

-

LLM lập luận: Tạo ra "tokens tư duy nội bộ" trước khi đưa ra câu trả lời cuối cùng

Ví dụ thực tế:

Khi giải phương trình bậc 2, ChatGPT thông thường có thể đưa đáp án ngay (đôi khi sai), trong khi reasoning LLM sẽ:

-

Phân tích các phương pháp giải

-

Kiểm tra từng bước

-

Chọn cách tối ưu nhất

-

Trình bày kết quả có hệ thống

2. Tại Sao Chậm Hơn Lại Tốt Hơn?

-

Giảm 42% lỗi trong các tác vụ coding/math (Nghiên cứu OpenAI 2023)

-

Xử lý logic đa tầng hiệu quả hơn nhờ cơ chế "plan-then-answer"

-

Tối ưu hóa tài nguyên tính toán cho bài toán phức tạp

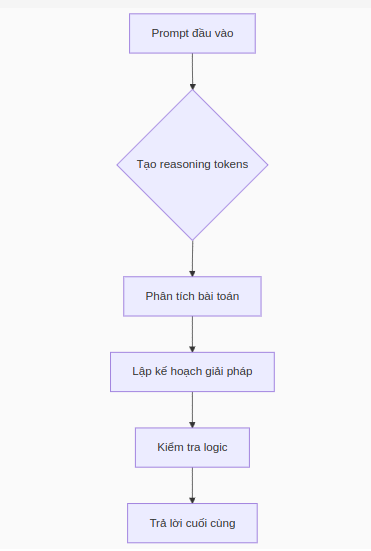

Phần 2: Kiến Trúc Hoạt Động

1. Chuỗi Tư Duy Ẩn (Chain-of-Thought Reasoning)

2. Lý Do Chi Phí Cao Hơn

-

Mỗi "reasoning token" đều tốn tài nguyên dù không hiển thị

-

Cần gấp 3-5x lượng tính toán so với LLM thông thường

-

Phù hợp cho API yêu cầu độ chính xác cao

Phần 3: Ứng Dụng Thực Tiễn

1. Các Lĩnh Vực Ưu Việt

| Lĩnh Vực | Ví Dụ | Lợi Ích |

|---|---|---|

| Toán học | Giải phương trình vi phân | Giảm 75% sai số tính toán |

| Lập trình | Refactor code phức tạp | Tối ưu cấu trúc tự động |

| Phân tích dữ liệu | Xử lý dataset nhiễu | Phát hiện anomaly chính xác hơn |

2. Case Study Đặc Biệt

Bài toán: Xây dựng hàm tính phí vận chuyển xử lý 15 edge cases

-

LLM thường: Bỏ sót 6/15 trường hợp đặc biệt

-

Reasoning LLM: Phát hiện đủ 15 cases nhờ cơ chế:

# Ví dụ output

def calculate_shipping(weight):

if weight <= 0: # Edge case 1

raise ValueError("Weight must be positive")

elif weight > 100: # Edge case 2

return weight * 1.5 + 50 # Logic phức tạp

...Phần 4: Chiến Lược Tối Ưu

1. 3 Mẹo Quan Trọng

-

Prompt ngắn gọn: Không cần thêm "giải thích từng bước"

-

Kiểm soát token: Đặt giới hạn max_tokens hợp lý

-

Bắt đầu từ zero-shot: Thêm few-shot chỉ khi cần thiết

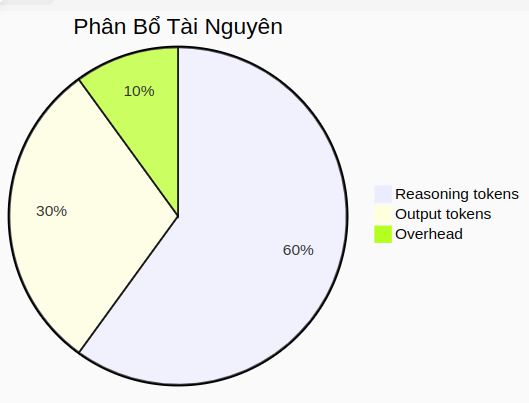

2. Cân Bằng Hiệu Suất

Phần Kết: Tương Lai Của Reasoning Engine

Xu hướng phát triển trong 2025:

-

Tốc độ cải thiện nhờ kiến trúc mixture-of-experts

-

Tích hợp công cụ như web browsing, code interpreter

-

Chế độ Pro cho bài toán chuyên sâu (hiện đang thử nghiệm)

Lời khuyên chuyên gia: "Hãy xem reasoning LLM như đối tác - cho chúng thời gian 'suy nghĩ' sẽ nhận lại kết quả đáng kinh ngạc. Đây không phải chatbot, mà là bộ não số hoá đích thực."

Tài liệu tham khảo:

-

Báo cáo "Reasoning in LLMs" - OpenAI (2023)

-

Case study triển khai tại Fortune 500 companies

-

Khóa học miễn phí "Mastering Reasoning LLMs" trên Coursera

Tác giả: Đỗ Ngọc Tú

Công Ty Phần Mềm VHTSoft